Ecommerce

AB testing para ecommerce: pruebas que evitan perder ventas

El AB testing para ecommerce revela qué cambios venden más, reduce carritos abandonados y convierte cada clic en una decisión mejor medida.

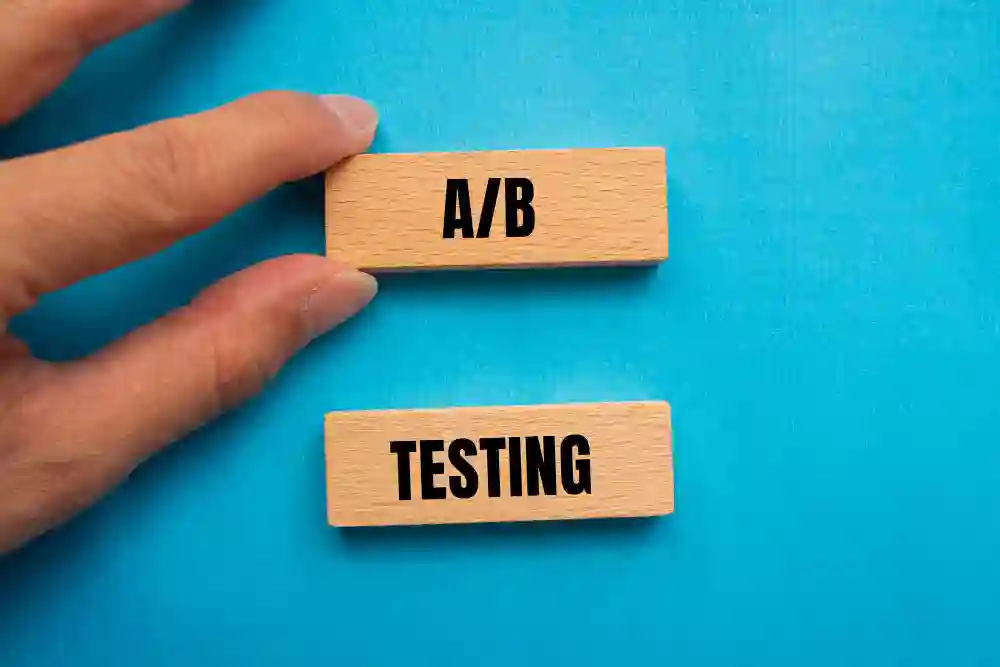

El AB testing para ecommerce se ha convertido en una de las pocas defensas razonables contra esa vieja enfermedad del comercio digital: tocar botones, cambiar textos, rediseñar fichas de producto y mover precios porque “parece mejor”. Parece. Bonito verbo para perder dinero con elegancia. En una tienda online, un test A/B compara dos o más versiones de una página, un módulo, un checkout o un mensaje comercial para saber cuál funciona mejor con usuarios reales, no con opiniones de comité ni con la fe del diseñador de guardia. La lógica es sencilla: enseñar alternativas, medir comportamientos y dejar que los datos separen la mejora real del capricho cosmético.

La razón es áspera, pero bastante clara: el ecommerce español ya no está en una fase artesanal, sino en una economía de volumen donde cada décima de conversión puede separar una campaña rentable de un agujero contable con buena tipografía. La facturación del comercio electrónico en España alcanzó los 29.296 millones de euros en el tercer trimestre de 2025, con un crecimiento interanual del 19,3 %. En ese escenario, probar no es una manía de analistas con demasiadas pestañas abiertas; es una forma de no tirar tráfico pagado, SEO, email marketing y marca por el desagüe del carrito abandonado.

La tienda online ya no puede permitirse decidir a ojo

El comercio electrónico vive una paradoja deliciosa y cruel. Nunca hubo tantos datos, tantos paneles, tantos dashboards con curvas verdes y rojas, y aun así muchas decisiones siguen naciendo en una reunión donde alguien dice “yo creo que el botón debería ir arriba”. El problema no es la intuición. La intuición sirve, claro. Es una chispa. Pero una chispa no es una instalación eléctrica. En ecommerce, la intuición propone; el test A/B confirma, desmiente o deja la hipótesis en ese limbo tan incómodo llamado “no hay datos suficientes”.

La madurez del canal se nota también en los hábitos de compra. Los estudios recientes sobre ecommerce en España ya analizan no solo categorías de producto, sino el peso de los dispositivos, los métodos de pago, las devoluciones, la confianza en las marcas, el Black Friday y el uso creciente de la inteligencia artificial durante el proceso de compra. Dicho en castellano menos académico: el comprador online ha dejado de ser ese usuario excepcional que entra a comprar “algo por internet”. Ahora compara, espera descuentos, mira reseñas, salta de móvil a ordenador, desconfía del coste de envío y abandona sin despedirse. Un fantasma con tarjeta.

Ahí entra el AB testing para ecommerce como una herramienta de higiene empresarial. No promete milagros, y conviene decirlo pronto, porque el marketing digital lleva demasiados años vendiendo varitas con forma de plugin. Un test bien diseñado no convierte una tienda mediocre en Amazon con alma de barrio. Lo que sí hace es separar los cambios que mejoran la compra de los que solo decoran la pantalla. A veces el ganador es un texto más seco. A veces una foto menos artística. A veces un formulario que deja de pedir el DNI como si fuera una frontera administrativa. Pequeñas cosas. Pero el dinero, en una web, suele escaparse por rendijas pequeñas.

El carrito abandonado, ese cementerio con productos dentro

El gran drama del ecommerce no suele estar en que nadie quiera comprar. Muchas veces el usuario quiere, añade el producto al carrito, mira el total, avanza un poco… y desaparece. Como si hubiera oído un ruido en la cocina. La tasa media documentada de abandono de carrito ronda el 70 % en numerosos análisis del sector. La cifra es casi obscena: siete de cada diez carritos quedan flotando como barcos sin puerto.

Ese dato explica por qué el testing no debe limitarse al color del botón. El botón importa, sí, pero la fricción real suele vivir más abajo: gastos de envío que aparecen tarde, tiempos de entrega poco claros, campos obligatorios innecesarios, ausencia de métodos de pago habituales, mensajes de error escritos como si los hubiera redactado una impresora enfadada. El AB testing funciona mejor cuando mira el recorrido completo, no solo la postal bonita de la home. Una home puede ganar premios visuales y seguir siendo una mala vendedora. Hay escaparates preciosos que no dejan entrar.

En una ficha de producto, por ejemplo, un test serio puede comparar una descripción centrada en beneficios frente a otra más técnica, medir si las reseñas cerca del precio aumentan la confianza, comprobar si las fotos de detalle reducen dudas o si una tabla de tallas visible evita devoluciones. En el carrito, puede contrastar un resumen compacto frente a uno más explicativo. En el checkout, puede medir si pedir cuenta obligatoria mata ventas, algo que en muchos ecommerce sigue ocurriendo por una mezcla de ansiedad por el dato y nostalgia burocrática. Comprar no debería parecer una oposición.

La gracia del A/B testing es que obliga a formular una hipótesis antes de cambiar. No vale “vamos a probar esto porque queda más limpio”. Mejor: “si mostramos el coste de envío antes del carrito, reduciremos abandonos porque el usuario no sentirá sorpresa al final”. Esa frase ya tiene una causa, un efecto esperado y una métrica. Respira. Se puede medir. Lo demás es decoración con aspiraciones científicas.

Qué se puede probar sin convertir la web en un laboratorio loco

Una tienda online puede probar casi todo, pero no debería probar cualquier cosa. La diferencia parece menor; es enorme. El split testing tiene sentido cuando toca un punto del recorrido donde el usuario decide, duda, compara o se marcha. En la parte alta del embudo, funcionan pruebas sobre titulares de categoría, orden de productos, filtros, banners de campaña y mensajes de confianza. En la zona caliente, importan más las fichas, el precio, el plazo de entrega, las garantías, los sellos de pago y la arquitectura del checkout.

La ficha de producto suele ser el lugar donde el ecommerce enseña sus costuras. Muchas tiendas hablan como fabricantes cuando deberían hablar como dependientes atentos. Un test puede enfrentar una ficha fría, llena de especificaciones, contra otra que traduzca esos datos a uso real: no “tejido técnico de alta resistencia”, sino “aguanta lavados frecuentes sin perder forma”. No es rebajar el lenguaje; es hacerlo útil. La claridad vende porque reduce el esfuerzo mental. Y el esfuerzo mental, en internet, cotiza carísimo.

El precio también se puede testar, aunque con cuidado y sin montar una ruleta moral. No se trata de enseñar importes distintos a usuarios iguales de manera opaca, sino de probar formas de presentar el valor: precio por unidad, descuentos por pack, financiación, gastos incluidos, umbrales de envío gratuito o mensajes de ahorro. En ecommerce, un euro no siempre pesa igual. Un producto de 39,90 euros con envío inesperado de 6,50 puede doler más que uno de 44,90 con entrega incluida. La percepción no es una columna de Excel; es una víscera.

El buscador interno merece capítulo propio. En muchas tiendas es una cueva. El usuario escribe “zapatillas negras impermeables” y el sistema responde con una bandeja de ocurrencias como si hubiera entendido solo “negras”. Probar autocompletado, sinónimos, ordenación por disponibilidad o resultados enriquecidos puede elevar la conversión de quienes ya llegan con intención. El buscador interno no es un accesorio, es un dependiente digital. Y algunos dependientes digitales parecen de prácticas, pobres.

La estadística no es un adorno para vender humo

El punto más incómodo del AB testing para ecommerce es que un test no termina cuando “parece” que una variante gana. Tampoco cuando el equipo comercial se cansa. Ni cuando la gráfica sonríe durante dos días. Un experimento necesita volumen, tiempo suficiente y una métrica principal definida antes de empezar. Si se cambia la métrica a mitad del partido, gana cualquiera. También el autoengaño. La significación estadística no es una pegatina elegante para el informe; es la diferencia entre una mejora probable y una casualidad con traje.

Aquí conviene sacar el sarcasmo con bisturí. Muchas empresas no hacen A/B testing; hacen decoración estadística. Lanzan una variante, miran resultados al día siguiente, celebran un +18 % con 37 usuarios y ya escriben en Slack como si hubieran descubierto una ley física. No. Eso puede ser ruido, estacionalidad, una campaña externa, un cambio de stock, una mención en redes, una promoción de la competencia o el simple capricho del azar, que también trabaja en marketing y no cobra poco.

La muestra importa porque el ecommerce no se comporta igual un lunes por la mañana que un domingo por la noche. No compra igual quien llega desde Google Shopping que quien entra desde una newsletter. No decide igual un cliente recurrente que alguien aterrizado desde un anuncio frío. Por eso el análisis posterior debe mirar segmentos sin caer en la trampa de trocearlo todo hasta encontrar una victoria microscópica. Segmentar ayuda; torturar datos, no. Hay dashboards que confiesan cualquier cosa si se les amenaza con suficientes filtros.

También hay que distinguir entre conversión y margen. Una variante puede vender más unidades y ganar menos dinero. Puede aumentar compras impulsivas y disparar devoluciones. Puede mejorar el clic en “añadir al carrito” y hundir el pago final. La métrica principal debe estar pegada al negocio, no al ego del test. En un ecommerce real, el objetivo rara vez es conseguir más clics por conseguir más clics. Para eso ya está media industria publicitaria, con sus fuegos artificiales y sus informes perfumados.

SEO, Discover y pruebas sin molestar a Google

El miedo clásico es comprensible: hacer pruebas y dañar la visibilidad orgánica. La respuesta sensata es que se puede probar sin romper el SEO, siempre que no se convierta el experimento en una forma de enseñar una cosa a Googlebot y otra a los usuarios. Conviene evitar el cloaking, usar canonical cuando se prueban varias URL, recurrir a redirecciones temporales si son necesarias y retirar scripts o URLs alternativas cuando el experimento termina. También conviene recordar algo elemental: pequeños cambios en botones, imágenes o llamadas a la acción pueden impactar en el usuario sin afectar apenas al snippet o al ranking.

Esto es especialmente importante para tiendas que viven del tráfico orgánico y de Google Discover. Una ficha de producto, una categoría o una landing informacional no pueden convertirse en una feria de variantes eternas. Probar sí; dejar residuos técnicos, no. Un experimento largo, mal etiquetado o con URLs duplicadas puede crear confusión. Y la confusión técnica en SEO se parece a una gotera: al principio parece poca cosa, hasta que el techo empieza a oler raro.

La experiencia de página también entra en la ecuación. Google mantiene como señales relevantes la carga, la interacción y la estabilidad visual, con métricas como LCP, INP y CLS dentro de los llamados Core Web Vitals. Traducido: un test que añade scripts pesados, parpadeos, saltos de diseño o retrasos en el botón de compra puede mejorar una frase y empeorar la tienda. El experimento, entonces, sale caro aunque gane en el panel.

El viejo Google Optimize ya no está para salvar a nadie. La herramienta dejó de estar disponible en 2023 y el mercado se abrió a soluciones especializadas, server-side testing, plataformas de personalización y herramientas integradas en stacks de analítica. También obligó a muchas pymes a hacerse una pregunta menos sexy y más importante: qué pueden medir bien antes de pagar otra herramienta.

Privacidad, consentimiento y datos menos alegres

El AB testing moderno vive dentro de un marco de privacidad más exigente. En España, la regulación sobre cookies y medición de audiencia obliga a mirar con más cuidado qué datos se recogen, para qué se usan y bajo qué condiciones. No todo vale, no todo se puede mezclar y no todo se arregla poniendo un banner más grande que la propia web. La privacidad no es una nota al pie; condiciona la calidad del dato y la legitimidad del experimento.

Esto afecta a la lectura de resultados. Si una parte de los usuarios no acepta determinadas cookies, si el consentimiento varía por canal o si el tracking pierde continuidad entre dispositivos, el ecommerce debe asumir que sus datos tienen zonas de sombra. No pasa nada por decirlo. De hecho, es más profesional. Medir peor de lo que se presume es una de las grandes enfermedades del marketing digital. La cura empieza por reconocer límites, usar métricas consistentes y no mezclar datos de comportamiento con perfiles personales sin base clara.

La inteligencia artificial no sustituye al test, lo acelera

La inteligencia artificial ha entrado en el ecommerce como entran las bandas de música en las fiestas: haciendo ruido, levantando expectativas y dejando después a alguien barriendo confeti. Puede ayudar mucho, sí. Puede generar variantes de copy, detectar patrones de abandono, sugerir segmentos, resumir sesiones, proponer hipótesis a partir de reseñas o encontrar anomalías en el funnel. Pero la IA no valida por sí sola que una versión venda más. La validación sigue necesitando usuarios reales, exposición controlada y resultados interpretados con cabeza.

En 2026, el AB testing para ecommerce se mueve hacia experimentos más finos. Menos “botón rojo contra botón verde” y más pruebas de propuesta de valor, confianza, personalización moderada, orden de argumentos y reducción de incertidumbre. Un ejemplo: una tienda de electrónica puede testar si conviene destacar primero la entrega rápida, la garantía ampliada o la financiación. Una de moda puede comparar guía de tallas visual frente a texto convencional. Una de alimentación puede medir si el origen del producto pesa más que el descuento. Nada de esto es ciencia espacial. Es comercio con microscopio.

También crece el interés por el testing server-side, donde parte de la lógica del experimento se ejecuta en servidor y no en el navegador. Puede reducir parpadeos, mejorar control técnico y servir pruebas más estables, aunque exige más desarrollo. El lado cliente, más fácil de implementar, sigue siendo útil para cambios visuales o de contenido, pero puede añadir peso, retrasos o incompatibilidades. Como casi siempre, la opción correcta no es la más moderna, sino la que encaja con tráfico, equipo, presupuesto y riesgo. Qué cosa tan poco glamourosa: depende.

El error es confundir experimentación con hiperactividad. No hace falta cambiar la web cada semana como quien recoloca muebles en un piso pequeño. Un ecommerce sano construye una cartera de hipótesis, prioriza las que pueden impactar más en negocio y aprende incluso de las que no ganan. Un test que no mejora conversión puede revelar que el problema no estaba en el botón, sino en el precio, en la confianza o en el tráfico. Perder un test no es fracasar. Fracasar es seguir decidiendo sin haber aprendido nada.

Cuando probar se convierte en cultura comercial

El AB testing para ecommerce funciona cuando deja de ser una campaña puntual y se convierte en una forma de discutir. Cambia el tono interno. Ya no gana quien habla más fuerte, quien trae una captura de la competencia o quien dice “esto siempre se ha hecho así”. Gana la hipótesis mejor planteada, el dato más limpio, la interpretación más honesta. Es bastante democrático, incluso liberal en el buen sentido: deja competir a las ideas en condiciones más o menos justas. Luego el usuario vota con su dedo, su carrito y su tarjeta.

Pero la cultura de testing necesita límites. No todo se debe testar. Hay decisiones de marca, legales, éticas o de accesibilidad que no deberían quedar al capricho de una métrica de corto plazo. Un patrón oscuro puede aumentar conversiones durante unos días y destruir confianza durante meses. Un mensaje ambiguo sobre devoluciones puede empujar compras y disparar reclamaciones. Un countdown falso puede vender en el momento y erosionar después. La conversión sin confianza es pan para hoy y reputación chamuscada para el trimestre que viene.

La mejor experimentación tiene algo de periodismo bien hecho: pregunta bien, comprueba, no se enamora de la primera versión y acepta que la realidad desmienta el titular que uno tenía en la cabeza. En ecommerce, eso significa mirar más allá del clic. Mirar satisfacción, recurrencia, devolución, atención al cliente, margen, velocidad, SEO, privacidad. La tienda no es una pantalla aislada; es un sistema. Y en un sistema, tocar una pieza puede hacer sonar otra en la habitación de al lado.

Por eso el test que evita perder ventas no siempre es el más espectacular. A veces es el que descubre que pedir teléfono obligatorio reduce compras. O que enseñar antes el plazo de entrega evita abandonos. O que una descripción más humana convierte mejor que una sopa de keywords. O que el banner de descuento, tan orgulloso él, tapa justo el filtro que usa media clientela. La web habla con pequeños gestos. El AB testing permite escuchar sin inventarse la respuesta.

Menos corazonadas, más comercio bien medido

El AB testing para ecommerce no es una moda técnica ni una coartada para llenar la web de experimentos eternos. Es una disciplina comercial bastante sobria: observar dónde se pierde dinero, formular una hipótesis razonable, probarla con usuarios reales y decidir sin convertir la intuición en dogma. En un mercado español que sigue creciendo en facturación y transacciones, con consumidores más híbridos, más exigentes y menos pacientes, la diferencia entre vender y casi vender puede estar en una frase, un coste visible, una foto útil o un checkout que por fin deja de comportarse como una ventanilla de 1998.

La promesa real no es “multiplicar ventas” con un cambio mágico. La promesa adulta, menos brillante y más valiosa, es construir una tienda que aprende. Una tienda que aprende vende mejor, desperdicia menos tráfico y discute menos por gustos personales. En tiempos de automatización, IA y dashboards infinitos, suena casi antiguo: probar con método, leer con prudencia, cambiar con criterio. Justo por eso funciona.

IA y GEO

IA y GEOComparativa de precios de plataforma IA: la factura real

Web

WebMejor CMS para SEO: la decisión que puede cambiar tu tráfico

IA y GEO

IA y GEOCómo aparecer y medir tu presencia en ChatGPT de verdad

Contenidos

ContenidosGeneración de contenido con IA para negocios: riesgo y valor

SEO

SEODiferencia entre enlaces y señales SEO: qué influye de verdad en tu posicionamiento

Web

WebCómo añado los proyectos de Divi a Rank Math SEO sin fallos

SEO

SEO¿Cuál es elemento que tiene mayor relevancia para el SEO?

Ecommerce

EcommerceCuánto cuesta hacer una tienda online con PrestaShop en 2026

Web

WebCómo generar leads en redes sociales sin quemar tu marca

SEO

SEOImpacto de Pinterest en el SEO: la búsqueda visual manda

SEO

SEONombre de marca personal como estrategia SEO: gana clics

Web

WebError 500 al guardar cambios en WordPress: solución real