IA y GEO

Bloquear crawlers de IA: blindar contenido o perder citas

La frontera entre proteger contenido y desaparecer de las respuestas generativas se estrecha.

Bloquear crawlers de IA ya no es una rareza de laboratorios ni una manía de editores paranoicos con el servidor echando humo. Es una decisión de negocio, de SEO técnico y de distribución: permitir que los bots de inteligencia artificial lean una web puede abrir la puerta a citas, menciones y tráfico desde respuestas generativas; cerrarla puede proteger contenido, ahorro de recursos y propiedad editorial, pero también dejar la marca fuera de los nuevos escaparates donde cada vez más usuarios resuelven búsquedas sin pisar diez resultados azules.

El punto incómodo es este: no todos los crawlers de IA sirven para lo mismo. Algunos rastrean para entrenar modelos; otros indexan contenido para búsquedas en ChatGPT, Claude, Perplexity o entornos similares; otros actúan cuando un usuario pide abrir una página concreta. Meterlos a todos en el mismo saco es como prohibir la entrada al cartero, al repartidor, al inspector y al ladrón porque todos llaman al timbre. Técnicamente cómodo. Comercialmente, bastante discutible.

El nuevo dilema: proteger el contenido o aparecer en respuestas generativas

Durante años, el archivo robots.txt fue una pieza discreta del SEO técnico, una alfombrilla en la puerta del sitio donde se indicaba a los buscadores qué podían rastrear y qué no. Nadie le dedicaba una reunión de dirección, salvo cuando Googlebot empezaba a devorar filtros, parámetros o páginas internas como una máquina tragaperras rota. Con la IA generativa, ese archivo se ha convertido en una frontera política. Pequeña, sí. Pero frontera.

La tensión nace porque los modelos de IA han usado y siguen usando contenido público de la web para aprender, responder, resumir y, en algunos casos, competir con las mismas páginas de las que se alimentan. Para un medio, un ecommerce, una consultora o una web especializada, el asunto no es filosófico. Es muy terrenal: quién usa mi contenido, para qué, con qué retorno y con qué control. El romanticismo de la web abierta suena muy bien hasta que tu trabajo acaba convertido en una respuesta sin clic, sin marca visible y sin ingreso.

Google ha separado parcialmente esta conversación con Google-Extended, un token de robots.txt que permite gestionar si el contenido rastreado por Google puede usarse para entrenar futuras generaciones de Gemini y para ciertos usos de grounding, sin afectar a la inclusión en Google Search ni actuar como señal de ranking. La letra pequeña importa: bloquear Googlebot es pegarse un tiro en el pie para cualquier estrategia SEO; bloquear Google-Extended es otra cosa, aunque no elimina todas las zonas grises del ecosistema Google.

OpenAI también diferencia sus bots. GPTBot se asocia al rastreo que puede servir para entrenamiento de modelos; OAI-SearchBot se usa para que una web pueda aparecer en las funciones de búsqueda de ChatGPT; y ChatGPT-User entra en juego cuando un usuario solicita una acción concreta, como visitar una URL desde ChatGPT o un GPT personalizado. El matiz no es decorativo. En esta guerra de permisos, una línea mal escrita puede sacar una marca de un sitio donde tal vez quería estar.

Aquí está la grieta por donde entra todo el debate. Si se bloquea todo, se gana una sensación de control. Limpia, casi higiénica. Pero también se renuncia a ser leído por sistemas que ya median parte de la búsqueda informativa. Si se permite todo, se maximiza la exposición, pero se entrega contenido a una maquinaria cuyo retorno no siempre es medible ni justo. Y entre ambas posturas hay una tercera vía: bloquear crawlers de entrenamiento y permitir crawlers de búsqueda. Menos épica, más sensata.

Robots.txt no es una muralla, es una señal

Conviene decirlo sin perfume técnico: robots.txt no blinda una web. Es una instrucción para bots que aceptan respetarla. Los buenos la leen. Los dudosos hacen como que miran al techo. Los malos ni se molestan. La diferencia entre “no rastrees esto” y “no puedes entrar” es la misma que entre un cartel de “prohibido pasar” y una puerta con cerradura.

Google explica que sus crawlers comunes respetan robots.txt cuando rastrean automáticamente, y OpenAI ofrece tokens separados para que los administradores gestionen GPTBot y OAI-SearchBot. Cloudflare, por su parte, ha llevado el debate al terreno de la infraestructura con controles específicos para crawlers de IA, reglas WAF, gestión de bots y modelos como Pay Per Crawl, que permite cobrar por acceso automatizado al contenido en determinadas condiciones.

La conclusión técnica es bastante sobria: robots.txt sirve para declarar preferencias, reducir rastreo legítimo y ordenar el acceso de bots conocidos. No sirve, por sí solo, para impedir scraping agresivo, suplantaciones de user-agent, tráfico desde IP rotatorias o accesos disfrazados de navegador humano. Para eso hacen falta capas de servidor, CDN, WAF, verificación de IP, límites de frecuencia y monitorización de logs. La verja del jardín está bien. Pero no sustituye a la puerta de casa.

Algunos análisis recientes sobre cumplimiento de robots.txt han observado que determinados bots respetan peor las directivas cuando son más restrictivas y que ciertas categorías, incluidos crawlers ligados a búsqueda con IA, no siempre consultan robots.txt de forma consistente. No es una sentencia universal contra todos los bots, pero sí una advertencia elegante, de esas que en producción se traducen como: no confíes tu defensa a un archivo de texto.

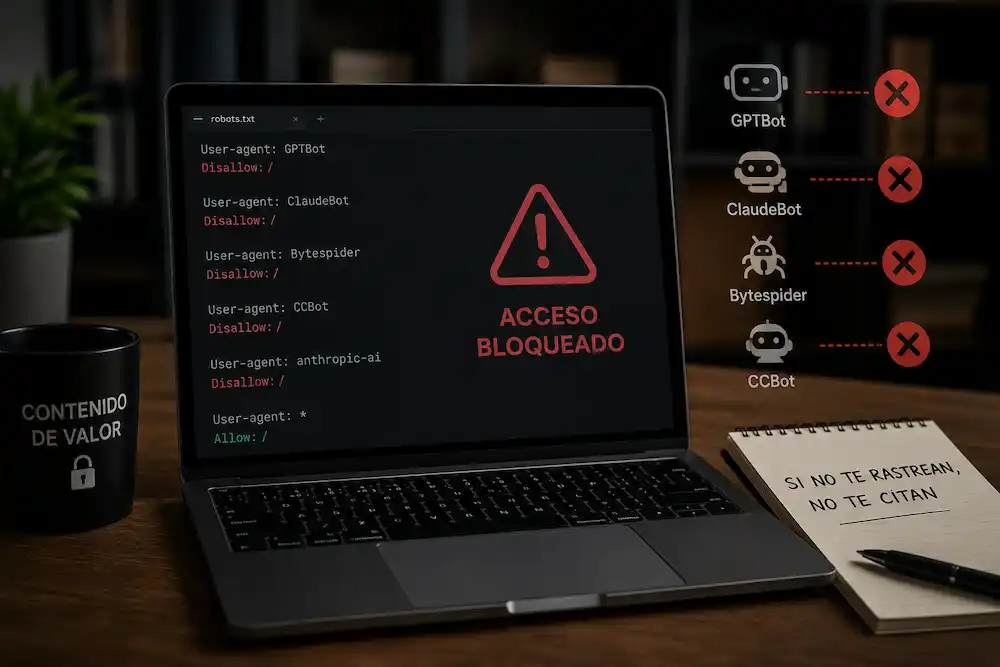

El error habitual en muchas webs no es bloquear o permitir. Es hacerlo sin saber quién entra. Hay sitios que han copiado plantillas de robots.txt como quien pega un conjuro medieval: GPTBot fuera, ClaudeBot fuera, CCBot fuera, PerplexityBot fuera, Google-Extended fuera, todo fuera. Luego se preguntan por qué no aparecen en determinadas respuestas generativas. Otros lo dejan todo abierto porque más visibilidad siempre es mejor, esa frase que suena a PowerPoint barato y a servidor sufriendo a las tres de la mañana.

Entrenamiento, búsqueda y uso bajo demanda no son lo mismo

El SEO clásico nos educó en una lógica sencilla: permitir a Google rastrear, indexar y mostrar. La IA generativa ha roto esa unidad. Ahora hay que separar tres verbos que antes parecían hermanos: entrenar, indexar y consultar. No es una distinción académica. Es la diferencia entre alimentar un modelo, aparecer como fuente o responder a una acción concreta de un usuario.

Entrenar significa que el contenido puede acabar incorporado, directa o indirectamente, a modelos futuros. No como una página recuperable con su URL y su marca, sino como parte de una masa estadística enorme. Para un editor, ahí está el miedo central: que el contenido se consuma como materia prima, sin atribución, sin licencia y sin retorno. Los bots de entrenamiento son los que más recelos despiertan. GPTBot, ClaudeBot, CCBot y otros rastreadores vinculados a corpus de datos aparecen una y otra vez en políticas de bloqueo de medios y grandes sitios.

Indexar para búsqueda con IA es otra película. OAI-SearchBot, Claude-SearchBot o PerplexityBot, cada uno con sus matices y sus políticas, buscan alimentar respuestas actuales, con enlaces, citas o referencias visibles. Ahí el contenido no solo “enseña” a un modelo; puede convertirse en resultado, mención o fuente en una respuesta. La diferencia para el SEO es brutal. No es lo mismo que te lean para aprender de ti que para enviarte usuarios, aunque el volumen de esos usuarios siga siendo incierto, desigual y, muchas veces, más opaco que una factura de telefonía.

El uso bajo demanda añade otra capa. Cuando un usuario pide a ChatGPT que visite una URL, o cuando un asistente abre una página concreta para responder a una petición, el rastreo no funciona como un crawler masivo. ChatGPT-User actúa en determinadas acciones iniciadas por usuarios, no como rastreador automático para indexar la web. Ahí el debate se parece menos al SEO y más al acceso humano mediado por software: un usuario pide ver algo, la máquina va a buscarlo.

Por eso, bloquear crawlers de IA con una regla global puede ser una decisión demasiado basta. Funciona, sí, del mismo modo que cerrar un restaurante evita que entre alguien que no paga. También evita que entren clientes. Una política madura suele distinguir entre bots de entrenamiento, bots de búsqueda, bots comerciales, bots desconocidos y bots abusivos. No se trata de abrazar a todos. Se trata de no disparar con una escopeta de feria contra toda la capa de distribución futura.

El matiz que separa protección y desaparición

La tentación del bloqueo total tiene algo de humano. Uno ve cómo las respuestas generativas ocupan espacio, resumen artículos, contestan dudas y convierten el contenido ajeno en una cápsula limpia, sin migas, sin olor a redacción, sin la fricción del clic. Y reacciona. Cierra la puerta. Pero internet rara vez premia las decisiones tomadas con el pulso acelerado.

La pregunta real es qué se protege y qué se sacrifica. Una base de datos propia, una investigación exclusiva o un contenido de pago no tienen el mismo valor estratégico que un artículo informativo pensado para captar demanda orgánica. Un ecommerce con miles de fichas sensibles no vive la misma realidad que una consultora que quiere aparecer en respuestas sobre SEO técnico, analítica o automatización. La misma regla aplicada a todos puede parecer orden. En realidad, suele ser pereza.

Qué gana una web al bloquear crawlers de IA

La primera ganancia es obvia: más control sobre el uso del contenido. Para medios, investigaciones, bases de datos, comparadores, catálogos, documentación técnica o webs con mucho contenido original, impedir el rastreo de entrenamiento puede reducir la probabilidad de que ese material alimente modelos sin autorización explícita. Reducir, no eliminar. Matiz importante. Internet tiene memoria, cachés, datasets antiguos, copias, agregadores, APIs y ese subsuelo de la web que nadie enseña en las conferencias con café de especialidad.

La segunda ganancia es operativa. Algunos crawlers consumen recursos, golpean servidores, recorren paginaciones inútiles o multiplican peticiones sobre páginas que no aportan negocio. En ecommerce, el problema se nota mucho: facetas, filtros, búsquedas internas, parámetros de ordenación, variantes, URLs casi duplicadas. Un crawler de IA mal gestionado puede convertir un catálogo en un laberinto para sí mismo y en una factura para el dueño de la web. No es ciencia ficción. Es Apache access log, madrugada y alguien preguntando por qué se ha disparado el consumo.

La tercera ganancia es estratégica. Bloquear determinados crawlers puede servir para forzar negociación. No todas las webs tienen poder para ello, claro. Un blog pequeño que bloquea GPTBot no cambia el equilibrio mundial de la IA. Un gran medio, una plataforma con contenido único o una base de datos vertical sí puede usar el acceso como ficha de intercambio: licencia, acuerdo comercial, pago por crawl, visibilidad garantizada, atribución más clara. Cloudflare ha empujado justamente esa conversación con sistemas de control y monetización del acceso automatizado, incluido Pay Per Crawl.

También hay una ganancia reputacional. Algunas marcas no quieren aparecer mezcladas en respuestas generativas sin contexto, o temen que fragmentos de su contenido sean resumidos de forma pobre, incompleta o directamente torpe. La IA no siempre cita bien; a veces cita lo que puede, no lo que debe. Para contenidos sensibles, legales, médicos, financieros o de alta precisión técnica, permitir rastreo indiscriminado puede acabar generando una versión aguada de la propia autoridad. Una sopa con el sabor correcto, pero sin el hueso.

El bloqueo, además, puede ayudar a proteger zonas de bajo valor público: staging mal cerrado, documentación antigua, archivos internos expuestos, páginas de búsqueda, etiquetas basura, resultados con parámetros, contenido duplicado o áreas que no deberían convertirse en entrada a sistemas externos. Aquí no hablamos de IA como villano de película. Hablamos de higiene web. La misma de siempre, solo que con focos nuevos.

Qué se pierde al cerrarlo todo

La pérdida más evidente es visibilidad en buscadores conversacionales. Si un sistema no puede rastrear una página para su índice de búsqueda, esa página tendrá menos posibilidades de aparecer como fuente en respuestas generativas. Permitir OAI-SearchBot ayuda a que el contenido pueda descubrirse, resumirse y citarse en ChatGPT Search. Bloquearlo no equivale solo a “no entrenes con mi contenido”; puede equivaler a “no me uses como resultado”.

Para muchas marcas, esa diferencia será cada vez más importante. Un usuario ya no siempre busca “mejor CRM para pymes” y abre cinco pestañas. A veces pregunta a un asistente, recibe una síntesis y hace clic solo si necesita validar, comprar o profundizar. El tráfico se concentra. La visita se encarece. La cita se convierte en escaparate. Y, nos guste o no, estar ausente de esas respuestas puede ser parecido a no estar en la primera página de Google en 2012. No igual, pero rima demasiado.

El segundo coste es la pérdida de señales de autoridad distribuida. Cuando un contenido aparece citado en ChatGPT, Perplexity, Claude o respuestas similares, la marca puede ganar reconocimiento aunque el clic sea menor. Es un tipo de visibilidad más difusa, difícil de medir con las herramientas clásicas, incómoda para quien necesita dashboards limpios. Pero existe. En sectores B2B, software, formación, salud, finanzas, legal, ecommerce técnico o turismo, una mención dentro de una respuesta puede influir más que una impresión perdida en Search Console.

El tercer coste es competitivo. Si una web bloquea todos los crawlers de IA y sus competidores permiten los de búsqueda, las respuestas generativas tenderán a apoyarse en esos competidores. No porque sean mejores, sino porque están disponibles. Es una verdad fea, pero muy de internet: lo rastreable gana opciones. El contenido cerrado puede ser excelente, preciso, caro de producir. Si el sistema no lo ve, no lo cita. La IA no hace arqueología sentimental.

Hay un cuarto coste menos visible: el bloqueo mal diseñado puede afectar a bots que sí interesan. Las preferencias dirigidas a Googlebot afectan a Search, Discover, News, Images y otras superficies de Google. Una regla escrita con prisa, una coincidencia demasiado amplia o una plantilla heredada pueden provocar daños colaterales. En SEO técnico, los accidentes rara vez llegan con música dramática. Llegan con una caída suave, una gráfica tibia y alguien diciendo no hemos tocado nada.

La opción sensata: bloquear por función, no por miedo

La política más razonable para la mayoría de proyectos no es “permitir todo” ni “cerrar todo”. Es separar por función. Bloquear entrenamiento cuando no hay licencia ni retorno claro. Permitir bots de búsqueda con IA cuando aportan visibilidad, citas o tráfico rastreable. Vigilar los bots bajo demanda. Limitar los abusivos. Y revisar logs, porque la realidad no vive en las notas de prensa.

Para una web editorial o un blog especializado, una configuración típica podría permitir Googlebot, Bingbot y los bots de búsqueda generativa que interesen, mientras bloquea bots de entrenamiento como GPTBot o CCBot si no se desea alimentar modelos. Para una tienda online con precios sensibles, stock cambiante y margen estrecho, puede tener sentido permitir rastreo de páginas públicas relevantes, pero cerrar facetas, parámetros, búsquedas internas y zonas que solo sirven para extraer datos. Para una SaaS B2B, quizá convenga permitir OAI-SearchBot y equivalentes, porque aparecer en respuestas comparativas puede valer más que proteger un post genérico sobre “qué es un CRM”.

El mapa no es fijo. Cambia por sector, por marca y por dependencia del tráfico orgánico. Un medio con contenido exclusivo puede endurecer su política. Una startup que necesita menciones puede abrir más la mano. Un ecommerce con catálogo replicable debe vigilar scraping de precios y fichas. Una consultora técnica puede convertir sus guías en imanes para respuestas generativas. La misma regla no sirve para todos. Quien venda una receta universal probablemente también venda auditorías en PDF con portada azul.

La parte técnica exige orden. Conviene revisar el robots.txt real, no el que alguien cree que existe; comprobar qué reglas añade el CMS, el hosting, el CDN o plugins de seguridad; identificar user-agents en logs; validar bots importantes por IP o métodos oficiales cuando estén disponibles; aplicar rate limiting a tráfico anómalo; y separar bloqueo de indexación. Porque otra confusión frecuente es esta: robots.txt impide rastrear, no siempre impide que una URL sea conocida. Para evitar indexación, hacen falta señales como noindex, pero el bot debe poder acceder a la página para leer esa metaetiqueta. Bonito lío, sí. Muy de la casa.

Cloudflare ha movido el tablero al ofrecer controles que van más allá del robots.txt, incluyendo bloqueo de bots de IA y esquemas de monetización del acceso. Su lógica introduce una idea relevante para los próximos años: si el contenido tiene valor, quizá el acceso automatizado también deba tener condiciones. Pero las reglas tienen que estar bien pensadas. Si una capa bloquea lo que otra pretende monetizar, la estrategia se convierte en un sudoku roto.

Una política mínima para no romper nada

Una política razonable empieza por clasificar. Bots de buscadores clásicos, bots de entrenamiento, bots de búsqueda generativa, bots bajo demanda, bots comerciales y tráfico sospechoso. Después se decide qué se permite, qué se limita y qué se bloquea. Parece obvio. No lo es tanto cuando una web lleva años acumulando reglas, plugins, redirecciones, parámetros y decisiones tomadas por personas que ya no trabajan allí.

El segundo paso es medir. No basta con mirar herramientas de SEO. Hay que entrar en los logs, revisar user-agents, detectar picos, cruzar consumo de servidor con valor real y observar referidos desde entornos generativos. Si el bot entra mucho y no deja nada, mala señal. Si entra poco y trae citas, autoridad o leads, conviene pensarlo dos veces antes de echarlo. El dato manda, aunque no siempre venga limpio.

Lo que deberían mirar SEO, editores y ecommerce

La primera pregunta práctica no es “qué bots bloqueo”, sino qué valor tiene cada tipo de acceso. Si un crawler entrena modelos sin citas ni tráfico, el retorno puede ser casi invisible. Si un crawler alimenta respuestas con enlaces, el retorno puede medirse parcialmente en analítica, referidos, menciones de marca, búsquedas asistidas y conversiones posteriores. Si un bot solo consume recursos sin aportar nada, al calabozo. Sin drama.

En analítica, el reto está en distinguir tráfico real desde respuestas generativas, rastreo previo y visitas bajo demanda. Los editores que permiten OAI-SearchBot pueden encontrar tráfico referido desde ChatGPT con parámetros UTM como utm_source=chatgpt.com. Es una pista útil, aunque no resuelve todo el embudo. Muchas menciones generativas no acaban en clic inmediato; otras provocan búsquedas de marca días después; algunas se quedan en influencia silenciosa. El SEO vuelve a parecerse al periodismo: sabes que algo circula, pero no siempre puedes meterlo entero en una celda de Excel.

En contenidos, la decisión obliga a afinar la propuesta. Si se permite a los bots de búsqueda acceder, conviene ofrecer páginas claras, actualizadas, bien estructuradas, con autoría, datos verificables, contexto y entidades reconocibles. Las respuestas generativas tienden a favorecer contenido que pueden entender y citar sin hacer contorsionismo. No basta con escribir largo. Tampoco basta con repetir la keyword como quien invoca lluvia. Hay que construir documentos con señal editorial: qué se sabe, quién lo explica, por qué importa, qué matices cambian la interpretación.

En ecommerce, la prioridad es evitar que el crawler se coma la trastienda. Se pueden permitir categorías, fichas relevantes y contenido informativo, pero bloquear parámetros de filtros, ordenaciones, búsquedas internas y zonas con datos sensibles o poco útiles. Aquí bloquear crawlers de IA no es una postura ideológica, sino una forma de proteger crawl budget, infraestructura y ventaja comercial. Un catálogo abierto sin criterio es un bufé libre para bots, comparadores y sistemas que no siempre devuelven valor.

En medios y blogs de noticias, el dilema es más áspero. Algunos estudios sobre robots.txt en sitios informativos han detectado una brecha creciente: los sitios reputados tienden a bloquear más crawlers de IA que los sitios de baja calidad o desinformación. El riesgo es paradójico: si las fuentes rigurosas cierran la puerta y las malas la dejan abierta, los sistemas generativos pueden acabar viendo más basura que criterio. La web, esa nevera comunitaria donde alguien siempre deja un táper sin nombre.

Blindaje con memoria, no con reflejos

Bloquear crawlers de IA puede ser una decisión inteligente cuando protege contenido original, reduce abuso técnico, evita entrenamiento no deseado o prepara una futura negociación. También puede ser una torpeza si se aplica con brocha gorda y deja a la web fuera de buscadores conversacionales, citas generativas y nuevos flujos de descubrimiento. El matiz, por una vez, no es cobardía. Es estrategia.

La respuesta madura no pasa por levantar un muro ni por dejar la puerta abierta con una nota de “coged lo que queráis”. Pasa por mirar logs, distinguir bots, separar entrenamiento de búsqueda, medir referidos, revisar reglas y asumir que el robots.txt ya no es un apéndice técnico que nadie lee. Es una declaración de distribución. Una pequeña política editorial escrita en texto plano.

El contenido seguirá valiendo más cuanto más único, verificable y útil sea. Pero en 2026 también vale por dónde circula, quién puede leerlo y en qué sistemas aparece citado. Blindar sin desaparecer: ahí está la frase que debería estar pegada en la pantalla de cualquier responsable SEO. No suena épica. Funciona mejor.

-

IA y GEO

IA y GEOComparativa de precios de plataforma IA: la factura real

-

IA y GEO

IA y GEOCómo aparecer y medir tu presencia en ChatGPT de verdad

-

Ecommerce

EcommercePara vender en Shopify hay que ser autónomo: respuesta legal

-

Web

WebMejor CMS para SEO: la decisión que puede cambiar tu tráfico

-

SEO

SEODiferencia entre enlaces y señales SEO: qué influye de verdad en tu posicionamiento

-

Google

GoogleCómo conectar TikTok Ads a Google Sheets: rápido y bien

-

SEO

SEONombre de marca personal como estrategia SEO: gana clics

-

Contenidos

ContenidosGeneración de contenido con IA para negocios: riesgo y valor

-

Ecommerce

EcommerceCómo tener AliExpress conectado con Shopify sin fallos

-

IA y GEO

IA y GEOComparación de Claude con otras IA: razonamiento y código

-

Web

WebCómo añado los proyectos de Divi a Rank Math SEO sin fallos

-

SEO

SEO¿Cuál es elemento que tiene mayor relevancia para el SEO?