IA y GEO

Citas LLM: cuando ranking y respuesta dejan de coincidir

Las citas LLM separan ranking y visibilidad: la IA ya no premia siempre al primer resultado.

Las citas LLM se han convertido en una nueva capa de visibilidad: ya no basta con estar arriba en Google, Bing o cualquier buscador clásico, porque los modelos generativos pueden construir una respuesta con unas fuentes y mostrar en el ranking orgánico otras distintas. La vieja promesa del SEO —posiciona, gana visibilidad, recibe clics— empieza a sonar como un contrato escrito con tinta simpática. Sigue importando, mucho, pero ya no explica todo el reparto.

El cambio de fondo es sencillo y bastante incómodo: los grandes modelos de lenguaje no siempre “leen” la web como la ve un usuario en una página de resultados. Primero recuperan información, después la sintetizan, luego deciden qué fuente merece aparecer como apoyo visible. Ese último gesto, la cita, ya es parte del producto. Google reconoce que AI Overviews y AI Mode pueden mostrar enlaces relevantes, pero también que ambos sistemas usan modelos y técnicas diferentes, de modo que las respuestas y los enlaces pueden variar incluso dentro del propio ecosistema de búsqueda.

La cita ya no es una medalla del ranking

Durante años, el ranking fue el escaparate. Primera posición, segundo resultado, tercero con suerte, el resto en ese sótano húmedo que llamábamos página dos. Con las respuestas generativas, la escena se ha torcido: una página puede no liderar los resultados orgánicos y, aun así, aparecer citada en una respuesta de IA; otra puede tener una posición brillante y quedarse fuera de la síntesis, como invitado con traje en la puerta de una fiesta privada.

Esto no significa que el SEO haya muerto, esa esquela se escribe cada seis meses y siempre resucita con mejor tráfico. Significa algo más fino: ranking y respuesta han dejado de ser equivalentes. El ranking ordena documentos. La respuesta selecciona, mezcla, comprime y presenta una interpretación. En medio hay recuperación semántica, confianza, frescura, estructura, autoridad percibida y una pizca de caja negra. No magia. Tampoco transparencia plena.

Google mantiene que las buenas prácticas SEO siguen siendo válidas para aparecer en AI Overviews y AI Mode, y que no existen requisitos técnicos adicionales específicos para estas funciones; una página debe estar indexada y ser apta para mostrarse con fragmento en la Búsqueda. La frase tranquiliza, pero no resuelve todo. Estar en el índice es el billete de entrada, no el asiento. La citación LLM ocurre después, cuando el sistema decide qué páginas sostienen mejor una respuesta concreta.

Ahí está el matiz que muchas estrategias todavía no han digerido. El SEO tradicional trabajaba para que una URL fuera considerada el mejor resultado. La visibilidad generativa empuja a otra pregunta: qué parte de esa URL puede ser extraída, entendida, comparada y utilizada como soporte en una respuesta. La página deja de competir solo como destino. Compite como material de construcción.

AI Overviews, AI Mode y la nueva mesa de mezclas

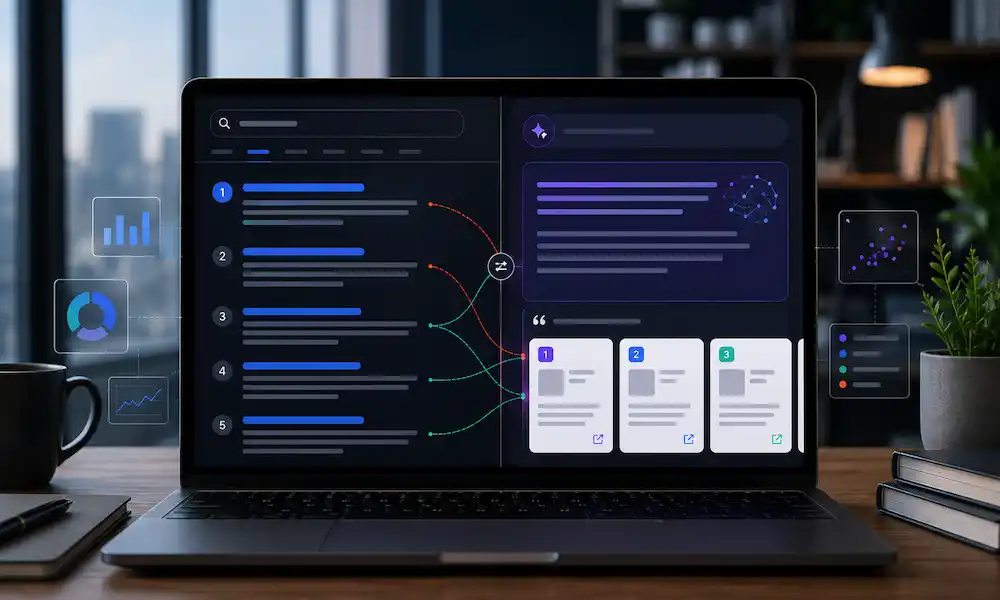

Google no está añadiendo una simple caja bonita encima de los resultados. AI Mode se presenta como una experiencia capaz de dividir una consulta en subtemas y buscar cada parte de forma simultánea, con enlaces útiles a la web. Eso cambia el juego, porque una consulta aparentemente única puede convertirse en varias búsquedas internas. El usuario pregunta una cosa; la máquina abre cajones, compara papeles, descarta unos y cita otros.

Para el SEO, esto huele a despacho cerrado con muchas puertas. Una página puede no coincidir con la formulación literal de la búsqueda original, pero sí con uno de esos subtemas internos que el sistema genera. En una búsqueda clásica, el título y la intención principal tiraban del carro. En una respuesta LLM, una tabla, una definición precisa, un dato fechado o una explicación muy clara en mitad del texto pueden convertirse en la pieza que el modelo necesita. Y entonces aparece la cita.

ChatGPT Search funciona con una lógica emparentada: OpenAI explica que, cuando busca en la web, puede reescribir la consulta del usuario en una o varias búsquedas más específicas y mostrar respuestas con citas o un panel de fuentes. No es una búsqueda espejo. Es una intermediación. El modelo interpreta, formula, recupera, responde. Ese trayecto deja huellas, pero no siempre deja una explicación completa.

La consecuencia práctica es fuerte: la consulta visible ya no siempre coincide con la consulta operativa. Un usuario escribe “mejor CRM para clínica dental pequeña” y el sistema puede buscar por software sanitario, gestión de pacientes, cumplimiento normativo, precios para pymes o comparativas recientes. Cada subconsulta abre una oportunidad distinta para ser citado. O para desaparecer, aunque la página esté razonablemente posicionada en Google para la búsqueda humana original.

Google también ha empezado a reforzar la visibilidad de los enlaces dentro de sus experiencias generativas. En mayo de 2026 anunció cambios para mostrar más enlaces directos en respuestas, sugerencias de artículos relevantes, vistas previas de sitios y señales ligadas a contenido original o suscripciones informativas. La dirección es clara: la IA quiere responder, pero necesita que las fuentes se vean lo suficiente para sostener confianza.

Los datos empiezan a desmontar la intuición SEO clásica

La intuición decía: si Google te coloca arriba, la IA te citará. Cómodo, lógico, demasiado limpio. Los estudios recientes no son tan amables. Un análisis longitudinal publicado en mayo de 2026 sobre Google AI Overviews trabajó con 55.393 consultas de tendencia en 19 categorías durante 40 días y detectó que la activación total de AI Overviews fue del 13,7%, con un salto hasta el 64,7% en consultas formuladas como pregunta. Lo más interesante para SEO: cerca del 30% de los dominios citados por AI Overviews no aparecían en la primera página orgánica mostrada junto a esos resultados.

Ese dato es dinamita tranquila. No explota en titulares fáciles, pero cambia la arquitectura mental. Si casi un tercio de las fuentes citadas puede venir de fuera de la primera página, entonces la cita LLM no es un simple premio al top 10. Hay otro mecanismo de selección. Un mecanismo que parece mirar credibilidad, adecuación de fragmentos, cobertura semántica y utilidad para la respuesta, no solo posición.

El mismo estudio también encontró que, al descomponer las respuestas en 98.020 afirmaciones atómicas, el 11% no estaba respaldado por las páginas citadas, con la omisión como fallo dominante. Esto introduce una incomodidad adicional: una fuente puede ser buena y, aun así, la respuesta puede apoyarse mal en ella. La cita no garantiza absorción fiel. Es un dedo señalando una pared; a veces detrás hay una puerta, a veces solo pintura fresca.

Otro trabajo de 2026, basado en 11.500 consultas reales, comparó Google Search, Gemini y AI Overviews y halló diferencias sustanciales entre las fuentes recuperadas por cada sistema, con una similitud media muy baja entre conjuntos de resultados. También observó que AI Overviews podía ser menos consistente ante pequeñas variaciones de una misma consulta. Traducido al idioma de una redacción SEO: dos búsquedas casi iguales pueden producir mapas de fuentes distintos.

Y no hablamos solo de Google. Un informe de Ahrefs recogido por Search Engine Journal comparó AI Mode y AI Overviews en septiembre de 2025 y observó que ambos sistemas citaban las mismas URL solo el 13,7% de las veces, aunque las respuestas mantenían una similitud semántica alta. Es decir, podían decir algo parecido con fuentes diferentes. Bonito para el usuario, irritante para quien mide visibilidad con una hoja de cálculo demasiado recta.

Qué entiende un modelo cuando decide citar

Una cita en un LLM no es exactamente un backlink, ni una posición orgánica, ni una mención de marca clásica. Conviene no meterlo todo en el mismo cajón, aunque el cajón tenga una etiqueta muy cara que diga “GEO”. Una cita es, ante todo, una señal de soporte dentro de una respuesta generada. Puede servir para justificar una afirmación, ofrecer lectura ampliada, atribuir una fuente o simplemente dar al usuario una salida hacia la web.

El proceso suele tener dos momentos. Primero, la selección de fuentes: qué documentos entran en el conjunto que el sistema considera útil. Después, la absorción: qué partes de esos documentos influyen realmente en la respuesta. Un estudio de 2026 sobre medición de GEO propuso precisamente diferenciar entre selección de cita y absorción de cita, porque aparecer como fuente no siempre implica haber modelado de verdad el contenido final. Las páginas con más influencia tendían a ser largas, estructuradas, semánticamente alineadas y ricas en evidencias extraíbles, como definiciones, cifras, comparaciones y pasos de procedimiento.

Ese punto es oro editorial, sin necesidad de convertirlo en receta de gurú con chaleco Patagonia. Los modelos parecen agradecer los textos que dicen cosas concretas, ordenadas, verificables y fáciles de aislar. No necesariamente textos planos. No necesariamente enciclopedias sin alma. Pero sí piezas donde una afirmación importante no queda enterrada entre metáforas, muletillas y espuma.

La mala noticia para algunos blogs: la autoridad de dominio puede abrir puertas, pero no basta. La buena noticia para medios y sitios especializados más pequeños: una página con experiencia real, datos propios, estructura limpia y una respuesta muy precisa puede colarse en la conversación aunque no domine todos los rankings. No siempre. No por decreto. Pero el hueco existe.

Aquí aparece una diferencia fina entre optimizar para leer y optimizar para ser usado. Un artículo puede gustar al lector, retenerlo, convertir. Perfecto. Pero también debe permitir que una máquina localice rápidamente qué afirma, sobre qué tema, con qué matiz y en qué contexto. Si el contenido es una niebla poética sin puntos de apoyo, el modelo pasa de largo. Si es una ficha técnica sin criterio, el lector se va. El equilibrio es ese animal extraño.

Por qué las citas LLM no sustituyen al SEO

La tentación del mercado es fabricar otra sigla, venderla como revolución y prometer que el SEO se ha quedado viejo, pobre señor con bastón. No. Las citas LLM no sustituyen al SEO; lo ensanchan y lo incomodan. La base sigue siendo rastreo, indexación, arquitectura, intención de búsqueda, contenido útil, autoridad, experiencia y una web técnicamente legible. Sin eso, la visibilidad generativa se queda en castillo de arena.

Google lo deja bastante claro en su documentación para propietarios de sitios: las mejores prácticas de SEO siguen siendo relevantes para sus funciones de IA, y no hay una optimización especial separada para aparecer en AI Overviews o AI Mode. La página debe cumplir requisitos técnicos, políticas de búsqueda y principios de contenido útil y fiable. La novedad no está en abandonar el SEO. Está en entender que el resultado visible puede adoptar otra forma.

Lo que cambia es la relación entre posición y recompensa. Antes, un buen ranking ofrecía una expectativa razonable de impresión, clic y sesión. Con respuestas generativas, la página puede aparecer citada y recibir poco tráfico, o no aparecer citada y aun así beneficiarse de marca si el modelo menciona su nombre. También puede perder clics porque la respuesta resuelve la necesidad en la propia interfaz. El tráfico ya no es el único termómetro, aunque siga pagando facturas. Qué cosas.

La medición se vuelve más sucia. Search Console cuenta impresiones y clics en Google, pero no ofrece todavía una visión completa y cómoda de cómo una marca aparece en respuestas generativas de diferentes plataformas. Las herramientas externas intentan estimar menciones, citas, share of voice y presencia en prompts, pero el terreno es móvil. Cambia el modelo, cambia la interfaz, cambia el país, cambia el prompt. También cambia la respuesta.

Por eso conviene separar tres métricas que antes se mezclaban alegremente: ranking orgánico, mención en respuesta y cita con enlace visible. Una URL puede rankear y no ser citada. Una marca puede ser mencionada sin enlace. Una fuente puede aparecer citada sin ocupar la parte más influyente de la respuesta. Y una página puede recibir la bendición máxima: ser usada, citada y clicada. Ese triplete ya no se consigue solo poniendo la keyword en el H1 y rezando al algoritmo como quien pone una vela.

El contenido que gana cuando la respuesta manda

El contenido que aspira a citas LLM no debería parecer escrito para robots, porque los robots también están aprendiendo a detectar el cartón piedra. Lo que sí necesita es densidad útil. Una página con experiencia real debe dejar claro qué sabe, por qué lo sabe y qué aporta que no sea una repetición de diez competidores hervidos en la misma olla.

En temas técnicos, las definiciones limpias pesan. Una buena explicación de qué son las citas LLM, por ejemplo, debe diferenciar entre cita, mención, fuente, ranking y enlace. No por manía académica, sino porque el modelo necesita piezas distinguibles. Si todo se llama visibilidad, todo se vuelve barro. Y el barro no se cita bien.

También pesan los ejemplos. “Una tienda online puede aparecer citada en una respuesta sobre devoluciones si su página explica con precisión plazos, excepciones, costes y normativa aplicable, aunque no esté primera para la keyword genérica ‘política de devoluciones ecommerce’”. Ese tipo de frase tiene textura. Contiene caso, entidad, condición y utilidad. Para el lector es comprensible; para el sistema, extraíble.

La frescura importa, pero no como fetiche de fecha cambiada. Una actualización real incorpora cambios de producto, nuevas interfaces, datos recientes, límites y contradicciones. En IA generativa, donde las plataformas modifican funciones casi con la alegría de quien mueve muebles a oscuras, un artículo de 2024 puede quedar viejo aunque conserve tráfico. El contenido perenne necesita mantenimiento editorial. No maquillaje.

La estructura también ayuda. Títulos claros, subtítulos que respondan a intenciones concretas, párrafos con una idea dominante, tablas cuando aportan comparación, ejemplos cuando aterrizan conceptos, datos con contexto. No hay que escribir como manual de instrucciones de una lavadora. Pero una página debe permitir que el lector y el modelo sepan dónde están. Un texto que se pierde en sí mismo es un pasillo con todas las puertas iguales.

La autoridad, por su parte, se vuelve menos decorativa. Las respuestas generativas pueden favorecer fuentes que el sistema considera creíbles, pero la credibilidad no nace solo de enlazar a otros. Nace de mostrar conocimiento propio, consistencia editorial, autoría clara, especialización temática, historial de calidad, ausencia de exageraciones y una arquitectura de sitio coherente. En castellano llano: no parecer una granja de contenidos con perfume caro.

GEO, spam y el peligro de optimizar como un trilero

La aparición de las citas LLM ha dado alas a la llamada optimización para motores generativos, o GEO. La etiqueta es útil si sirve para medir cómo aparecen marcas y fuentes en respuestas de IA. Se vuelve peligrosa cuando se vende como una colección de trucos para manipular modelos: menciones artificiales, páginas comparativas falsas, listados sesgados, textos inflados con entidades y “mejores herramientas” escritos con la misma honestidad que un horóscopo financiero.

Google ha reforzado sus políticas de spam para aclarar que manipular respuestas generativas en la Búsqueda entra dentro del problema de manipular sus sistemas, no solo de alterar rankings clásicos. El mensaje es relevante porque corta una fantasía muy extendida: la de que la IA era un patio trasero sin vigilancia donde se podía empujar cualquier marca a base de ruido. Puede que algunos trucos funcionen un rato. También funcionaba repetir una keyword cien veces en 2007. Luego llegaron las facturas.

La optimización sensata para citas LLM debería parecerse más a buena edición que a ingeniería oscura. Mejorar claridad, precisión, cobertura temática, datos propios, marcado útil, accesibilidad técnica y coherencia interna. Nada muy sexy para vender en una landing con degradados. Bastante eficaz, sin embargo, cuando se hace en serio.

Hay que desconfiar de promesas absolutas: “aparece en ChatGPT en siete días”, “domina AI Overviews”, “haz este archivo mágico y los modelos te leerán”. Cada plataforma combina modelos, índices, acuerdos, señales y sistemas de recuperación diferentes. Incluso dentro de Google, AI Overviews y AI Mode pueden variar en enlaces. El mercado quiere una palanca única. La realidad ofrece un panel lleno de botones, algunos sin etiqueta.

El verdadero trabajo está en construir páginas que puedan competir en ambos mundos: el de los resultados clásicos y el de las respuestas generativas. Eso implica escribir para búsquedas explícitas, pero también para subconsultas invisibles; trabajar keywords, pero también entidades; cuidar el snippet, pero también los fragmentos internos; medir rankings, pero también presencia de marca y citas. Menos humo. Más oficio.

Cómo leer la oportunidad sin perder la cabeza

Para seoetico.com y cualquier proyecto editorial de marketing digital, el tema de las citas LLM tiene una virtud: permite hablar del futuro de la búsqueda sin caer en ciencia ficción de congreso. Ya está ocurriendo. Las respuestas de IA aparecen, citan, desplazan, resumen y a veces se equivocan. Los usuarios se acostumbran a preguntar más largo. Los editores miran las impresiones con ceja levantada. Los consultores inventan dashboards. El circo, con su lona nueva.

El enfoque útil no es perseguir cada cita como quien persigue moscas en agosto. Es entender patrones. Qué tipos de consultas activan respuestas generativas. Qué dominios se repiten. Qué páginas propias son citables. Qué temas del sitio tienen autoridad suficiente. Qué contenidos son demasiado genéricos para merecer una fuente. Qué piezas contienen datos, ejemplos, comparativas o definiciones que puedan ser absorbidas por una respuesta.

También conviene asumir que la atribución será imperfecta. Una cita puede no traer clics. Una mención puede no aparecer en analítica. Una respuesta puede influir en la decisión del usuario antes de que visite la web. Para marcas B2B, ecommerce especializados, medios de nicho y consultoras, esa visibilidad previa al clic puede pesar más de lo que muestran los informes clásicos. No sustituye al tráfico. Lo rodea.

El SEO, en este escenario, se parece menos a una escalera y más a una red. Hay que estar bien posicionado, sí. Hay que ser rastreable, claro. Pero también hay que ser citadamente útil, una expresión fea pero práctica: tener fragmentos que merezcan ser usados como soporte. Una definición exacta. Una comparación honesta. Un dato propio. Una explicación que no se caiga al segundo párrafo. Una página que aporte algo cuando el modelo necesita fundamento y no relleno.

Cuando la fuente importa más que la posición

La ruptura entre ranking y respuesta no anuncia el fin del SEO; anuncia el fin de una comodidad. La visibilidad ya no vive solo en la lista azul, ni se mide únicamente por la escalera del top 10. Las citas LLM abren un terreno donde las fuentes compiten por ser recuperadas, comprendidas, absorbidas y mostradas. Cuatro verbos. Cuatro filtros. Cualquier estrategia que ignore alguno de ellos irá coja.

El contenido que mejor resiste este cambio no es el más largo por inercia ni el más optimizado con fórmulas de plástico. Es el que ofrece criterio, estructura, señales de confianza y utilidad verificable. El que sabe explicar sin empachar. El que deja datos donde hacen falta, contexto donde el lector se puede perder y precisión donde una frase vaga costaría visibilidad. Ranking y respuesta ya no coinciden siempre. Precisamente por eso, el SEO vuelve a exigir algo que nunca debió abandonar: pensar antes de publicar.

-

IA y GEO

IA y GEOComparativa de precios de plataforma IA: la factura real

-

IA y GEO

IA y GEOCómo aparecer y medir tu presencia en ChatGPT de verdad

-

Ecommerce

EcommercePara vender en Shopify hay que ser autónomo: respuesta legal

-

Web

WebMejor CMS para SEO: la decisión que puede cambiar tu tráfico

-

Google

GoogleCómo conectar TikTok Ads a Google Sheets: rápido y bien

-

SEO

SEODiferencia entre enlaces y señales SEO: qué influye de verdad en tu posicionamiento

-

SEO

SEONombre de marca personal como estrategia SEO: gana clics

-

Contenidos

ContenidosGeneración de contenido con IA para negocios: riesgo y valor

-

Ecommerce

EcommerceCómo tener AliExpress conectado con Shopify sin fallos

-

IA y GEO

IA y GEOComparación de Claude con otras IA: razonamiento y código

-

Web

WebCómo añado los proyectos de Divi a Rank Math SEO sin fallos

-

SEO

SEO¿Cuál es elemento que tiene mayor relevancia para el SEO?