SEO

Abuso de la IA en Internet: por qué cansa y aleja clientes

El abuso de la IA en internet erosiona confianza, ventas y reputación cuando textos, fotos y vídeos parecen falsos, en serie y sin criterio.

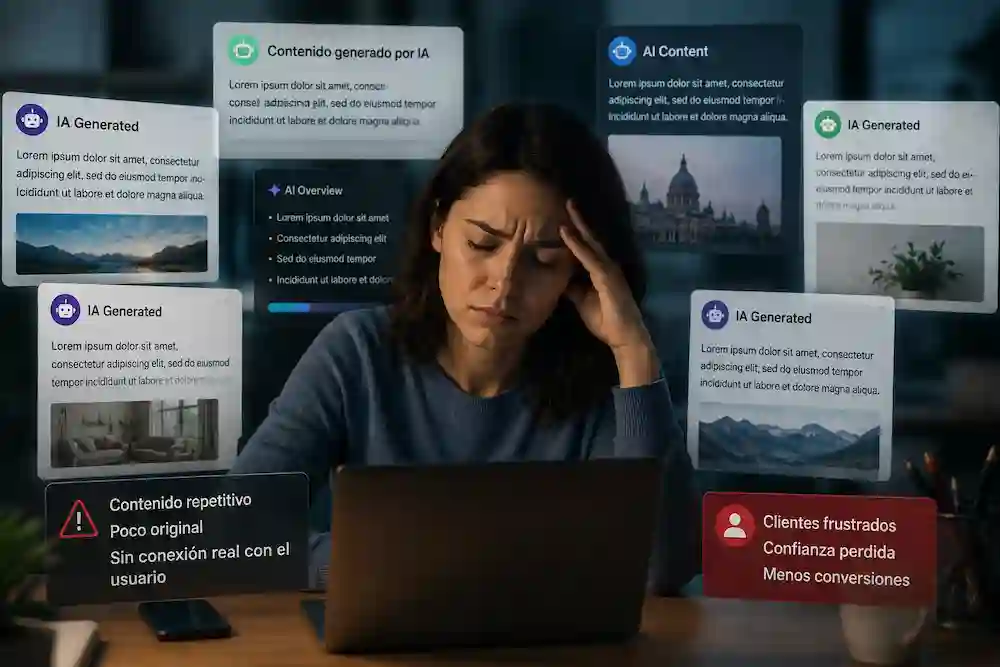

El abuso de la IA en internet ya no es una rareza ni una manía de cuatro tecnólogos con prisa. Es una escena cotidiana: textos con IA que suenan igual, fotos con IA demasiado limpias, vídeos con IA sin pulso, reseñas que parecen sacadas de una máquina de vending y asistentes que contestan como si hubieran hecho un cursillo de amabilidad corporativa en una nave sin ventanas. La consecuencia es sencilla, incómoda y bastante humana: cuando todo parece fabricado, el cliente empieza a desconfiar. No siempre se va dando un portazo. A veces solo deja de mirar.

La inteligencia artificial no es el problema. El problema es usarla como una manguera para inundar la web con contenido barato, opaco y sin criterio. En marketing digital, SEO y comunicación de marca, la pregunta ya no es si una empresa puede crear más textos, más imágenes y más vídeos con IA. Claro que puede. La cuestión seria es si ese volumen ayuda a vender, informar y fidelizar, o si acaba dejando en la boca del usuario ese sabor raro de escaparate falso, de conversación grabada, de promesa hecha por nadie.

Cuando todo parece IA, nada parece del todo creíble

Durante años, internet funcionó con una trampa aceptada: sabíamos que había filtros, retoques, titulares pensados para el clic y textos escritos con plantilla. Pero aún quedaba una sensación de presencia humana detrás. Una torpeza. Una opinión. Una foto con una sombra imperfecta. Un vídeo donde alguien dudaba medio segundo antes de hablar. Pequeñas pruebas de vida. La IA generativa ha cambiado la escala y, con ella, la percepción. Lo que antes era una ayuda puntual se ha convertido, en demasiados sitios, en una fábrica nocturna que no apaga las luces.

El usuario medio no necesita detectar técnicamente si una imagen fue generada por una herramienta concreta, si un párrafo salió de un modelo de lenguaje o si una voz fue clonada con un sistema de síntesis. Le basta con sentir que algo no encaja. Demasiada perfección también huele. Una foto comercial sin arrugas, sin textura, sin un fondo real; un vídeo de producto donde las manos parecen no pertenecer al cuerpo; un artículo que promete una explicación profunda y entrega una sopa templada de frases correctas. Ahí nace la fatiga digital.

En SEO, ese cansancio tiene un nombre menos poético: pérdida de confianza. Y la confianza, aunque algunos paneles de analítica todavía no la midan con la delicadeza que merece, termina apareciendo en los datos. Menos tiempo de lectura, menos clics internos, menos comentarios reales, menos búsquedas de marca, peor respuesta al correo, menos conversión. Una web puede tener muchas visitas y, aun así, estar vaciándose por dentro.

Google no castiga un contenido solo por haber usado IA, pero sí mira con lupa la utilidad, la originalidad, la experiencia y el valor real que aporta una página. La frontera se cruza cuando una web publica mucho para decir poco, cuando el contenido generado con IA existe más para ocupar resultados que para resolver algo. Dicho sin terciopelo: no molesta la herramienta; molesta la granja.

La fatiga del contenido sintético ya afecta a las marcas

El marketing se enamoró de la IA por un motivo comprensible: produce rápido, cuesta menos y permite alimentar canales que devoran piezas como una caldera antigua. Blog, newsletter, TikTok, Instagram, LinkedIn, ficha de producto, anuncio, landing, chatbot, vídeo vertical, imagen para campaña, guion, asunto de correo. Todo pide comida. La IA apareció como un horno industrial. Y claro, hubo fiesta.

La resaca ha llegado pronto. Los consumidores no rechazan necesariamente que las marcas usen IA; rechazan sentirse engañados, sustituidos o tratados como si no notaran nada. Hay una diferencia enorme entre usar IA para corregir una foto real, resumir datos, generar borradores o mejorar una atención básica, y sustituir la voz de la empresa por una máscara que habla demasiado bien y no dice casi nada.

Ese matiz pesa en la experiencia de usuario. Una web puede ahorrar costes con automatización y, al mismo tiempo, encarecer su relación con los clientes si les obliga a atravesar capas de contenido sintético, respuestas repetidas y promesas sin cara. Es el viejo truco de lo barato que acaba saliendo caro, pero con interfaz bonita y tipografía limpia. Muy moderno todo. También muy frágil.

El problema no está solo en publicar mucho, sino en publicar mucho contenido que parece no venir de ningún sitio. Textos sin mundo. Imágenes sin realidad. Vídeos sin cuerpo. Contenido sintético presentado como si fuera experiencia directa. Cuando una marca hace eso durante semanas o meses, no está solo llenando su calendario editorial. Está enseñando al público a desconfiar de ella.

Textos con IA: escribir rápido no es escribir con criterio

El texto generado con IA tiene una virtud peligrosa: suena razonable. No suele llegar roto, no comete faltas groseras, mantiene una estructura limpia y rellena los huecos con una soltura casi hipnótica. Ese es precisamente su riesgo. Un mal texto humano se ve venir; un mal texto de IA muchas veces entra con traje planchado.

En SEO, el abuso aparece cuando una web publica decenas o cientos de artículos que dicen lo mismo que ya existe, con frases intercambiables, sin experiencia directa, sin datos propios, sin una mirada editorial reconocible. El resultado puede indexarse, incluso puede posicionar durante un tiempo si el nicho es débil. Pero no construye autoridad. No genera memoria. No deja una frase en la cabeza del lector. Es contenido de paso, como esos hoteles de carretera que nadie recuerda salvo por la máquina de café.

Para un blog de marketing digital, la línea roja es clara: la IA no debe sustituir el criterio editorial. Puede ayudar a preparar un esquema, limpiar un párrafo torpe, proponer titulares, detectar repeticiones o ordenar documentación. Pero el valor debe venir de otro sitio: de campañas reales, de clientes reales, de pruebas, de errores, de datos contrastados, de ejemplos concretos, de una opinión que se pueda defender sin esconderse detrás de una herramienta.

Un artículo sobre SEO escrito con IA puede explicar qué es la intención de búsqueda. Uno bueno, en cambio, contará qué ocurre cuando una empresa optimiza para una keyword preciosa pero atrae a usuarios que no compran nada. Dirá que una URL puede tener tráfico y ser inútil. Mostrará una escena reconocible: el responsable de marketing celebrando posiciones mientras ventas pregunta, con cara de pocos amigos, dónde están los leads. Eso no lo da una plantilla. Eso lo da la calle.

La escritura artesanal cuesta más porque exige tiempo, lectura, edición y una cierta mala leche saludable. Pero no significa volver a la pluma de ganso. Significa usar tecnología sin entregar la voz. En una web seria, la IA puede ser becaria, correctora, documentalista o sparring. Lo que no conviene es convertirla en directora editorial con acceso ilimitado al botón de publicar.

Fotos y vídeos sintéticos: la autenticidad también se mira

La imagen tiene menos paciencia que el texto. Un párrafo mediocre puede sobrevivir si el tema interesa. Una foto falsa, en cambio, puede dinamitar la confianza en dos segundos. El ojo humano perdona antes la baja producción que la mentira estética. Una tienda online con fotos reales, algo imperfectas pero coherentes, puede vender mejor que una galería de modelos imposibles generados por IA mirando al infinito con piel de anuncio de perfume caro.

En ecommerce, turismo, salud, formación, inmobiliaria y marca personal, este punto es crítico. Si una empresa muestra un despacho que no existe, un equipo que no existe, un producto que no se corresponde con lo enviado o un “cliente satisfecho” generado por IA, el problema ya no es creativo. Es reputacional. La frontera entre embellecer y engañar se cruza despacio, como quien pisa una alfombra mullida, pero al otro lado espera una caída bastante dura.

Los vídeos generados o manipulados con IA añaden otra capa. Voces clonadas, avatares, testimonios sintéticos, demostraciones irreales. Sirven para explicar procesos, traducir contenidos o crear piezas educativas, sí. Pero cuando se usan para simular presencia humana, autoridad profesional o experiencia de cliente, entran en una zona gris que se está oscureciendo deprisa. La audiencia no quiere descubrir después que la persona que le recomendaba un producto no existía. Qué cosas.

No se trata de prohibir toda imagen artificial. Una ilustración generada con IA puede ser honesta si se presenta como tal. Un recurso visual abstracto para explicar una idea no tiene por qué dañar la confianza. El problema aparece cuando la imagen pretende pasar por prueba. Una foto de producto, una instalación, un antes y después, un testimonio, una noticia visual o un caso de éxito no son adornos: son evidencia. Y la evidencia falsa, aunque sea muy bonita, sigue siendo falsa.

Reglas, límites y transparencia: Europa empieza a poner cartel

La regulación viene empujando por una razón bastante elemental: la mentira sintética ya no es artesanal. Antes falsificar una imagen, una voz o un vídeo requería habilidad, tiempo y cierta infraestructura. Ahora basta con una instrucción bien escrita, una herramienta barata y pocos escrúpulos. La ley, que suele llegar tarde y con los zapatos mojados, empieza a marcar obligaciones de transparencia.

En la Unión Europea, el Reglamento de IA introduce un marco pensado para ordenar usos de la inteligencia artificial, con especial atención a los sistemas de riesgo, los contenidos sintéticos y las prácticas que pueden confundir al ciudadano. La idea de fondo es sencilla: si algo parece real pero ha sido fabricado o alterado artificialmente, el usuario debe saberlo cuando esa información sea relevante para interpretar el contenido.

No hace falta poner un cartel luminoso en cada retoque menor o en cada apoyo técnico. Pero sí conviene distinguir entre asistencia y sustitución. Mejorar la luz de una foto no es inventarse una persona. Corregir el sonido de una entrevista no es clonar una voz para que diga lo que nunca dijo. Usar IA para ordenar documentación no es publicar deepfakes con apariencia de prueba. La diferencia no es académica. Es la diferencia entre ayudar y manipular.

Para empresas y medios, esto obliga a ordenar la casa. Conviene saber qué contenidos se han generado con IA, cuáles han sido editados, quién los revisó, con qué finalidad se publican y qué nivel de transparencia necesita cada caso. No por burocracia estética, sino por supervivencia de reputación. Cuando llegue una crisis, no bastará con decir “lo hizo una herramienta”. La responsabilidad será de quien lo publicó, lo aprobó o lo usó para vender.

La publicidad también tiene su propio terreno minado. Las promesas exageradas sobre IA, las reseñas generadas, los supuestos casos de éxito inventados y las imágenes que falsean prestaciones pueden convertir una campaña en un problema legal y reputacional. La etiqueta “con IA” no convierte una promesa floja en verdad. Tampoco convierte una opinión inventada en opinión legítima.

Mejor artesanal, sí, pero no como pose romántica

“Todo artesanal” suena bien, casi huele a pan de pueblo. Pero en marketing digital también puede ser una trampa. Hacerlo todo a mano no siempre es viable, ni necesariamente mejor. Una empresa pequeña puede necesitar IA para competir con estructuras más grandes. Un medio puede usarla para transcribir entrevistas, revisar metadatos, clasificar documentación o preparar versiones accesibles. Un ecommerce puede apoyarse en automatización para mantener fichas de producto actualizadas. Eso no es decadencia; es oficio con herramientas nuevas.

La cuestión no es artesanal contra artificial. La cuestión es control editorial contra producción ciega. Hay contenidos donde la intervención humana debe ser máxima: páginas de venta estratégicas, artículos de autoridad, casos de éxito, fotografías de producto, testimonios, comunicación de crisis, piezas sobre salud, finanzas, derecho, seguridad o política. Hay otros donde la IA puede aportar eficiencia sin romper nada: borradores internos, variaciones de asuntos, etiquetas, resúmenes, documentación técnica revisada, traducciones supervisadas, subtítulos, limpieza de audio.

El error es aplicar el mismo molde a todo. Una descripción breve de una categoría secundaria puede admitir más asistencia automatizada que una landing principal de servicios. Un post informativo evergreen puede apoyarse en IA para estructurar, pero necesita revisión humana, ejemplos propios y actualización real. Una campaña emocional de marca no debería sonar como un generador de frases corporativas con alergia al riesgo. El usuario no pide que todo sea lento. Pide que no le tomen por tonto.

La artesanía, en internet, no siempre significa escribir cada palabra desde cero mirando por la ventana con café frío. A veces significa elegir. Cortar. Reescribir. Verificar. Cambiar una imagen demasiado perfecta por una foto real del equipo. Sustituir un avatar sonriente por una persona que responde con su nombre. Reconocer que una pieza sintética debe ir marcada. Decidir que no todo lo que puede publicarse merece ser publicado.

Ahí está el punto liberal del asunto, entendido en sentido clásico: libertad para usar tecnología, sí; responsabilidad por sus efectos, también. La innovación sin confianza acaba en chatarra brillante. Y el mercado, cuando se cansa, vota con el pulgar: cierra pestañas, ignora anuncios, se da de baja, compra en otro sitio.

El usuario no odia la IA: odia sentirse parte de una prueba

La reacción contra los contenidos sintéticos no nace solo de la tecnología. Nace de una sospecha más profunda: la de estar siendo usado como sujeto experimental sin permiso. Un cliente entra en una web y no sabe si las reseñas son reales, si las fotos representan el producto, si el chat entiende su caso, si el artículo fue revisado, si el vídeo muestra una persona o una máscara. Todo parece cómodo, pero nada parece firme. Como caminar por un centro comercial construido con cartón piedra.

Para una empresa, esa sensación es venenosa. La confianza no se pierde únicamente por una gran mentira; también se erosiona por pequeñas ambigüedades acumuladas. Un post demasiado genérico. Un anuncio con imagen sospechosa. Una newsletter que llama al cliente por su nombre con una familiaridad de robot educado. Un chatbot que promete resolver y acaba repitiendo “entiendo tu frustración” como quien reza un mantra en una centralita.

El mejor uso de la IA es el que desaparece detrás de una experiencia mejor, no detrás de una simulación peor. Que una herramienta ayude a responder más rápido está bien. Que finja empatía sin capacidad de resolver, no. Que una IA sugiera ideas para un artículo es útil. Que publique veinte piezas sin experiencia ni edición, no. Que una imagen sintética ilustre un concepto abstracto puede funcionar. Que sustituya una prueba real, una persona real o un producto real, rompe el pacto.

El cliente no exige pureza tecnológica. Exige claridad. Quiere saber cuándo habla con una persona, cuándo una imagen representa algo real, cuándo una opinión procede de alguien que ha probado un producto, cuándo una marca responde por lo que publica. Esa exigencia no es nostalgia. Es una defensa mínima en una red donde cada día resulta más barato fabricar apariencia.

El valor vuelve a estar en lo verificable

El abuso de la IA en internet está empujando una paradoja curiosa: cuanto más fácil es producir contenido, más valioso se vuelve demostrar origen, criterio y responsabilidad. La foto real vuelve a tener peso. La firma importa. La experiencia directa gana terreno. El dato propio vale más que el párrafo elegante. La voz reconocible destaca entre miles de textos que hablan igual, con esa cortesía de aeropuerto internacional.

Para el SEO, esto debería sonar familiar. Google lleva años empujando hacia el contenido útil, fiable, con señales de experiencia y autoridad. La IA no elimina esa exigencia; la hace más dura. En un entorno saturado de piezas correctas, la diferencia no será publicar más rápido, sino publicar algo que merezca existir. Una frase vieja, casi de editor gruñón, pero bastante actual.

Las marcas que entiendan esto usarán IA sin pedirle que sea humana. La usarán para quitar peso muerto, no para inventar verdad. Para acelerar lo mecánico, no para falsificar lo sensible. Para ampliar capacidades, no para borrar la responsabilidad. El futuro no será todo artesanal ni todo automático. Será híbrido, claro, pero con una condición: que el usuario pueda pisar sin sentir que el suelo es de mentira.

La tecnología seguirá avanzando, y conviene que avance. Pero una web, una marca y una estrategia de contenidos no se sostienen solo con eficiencia. Necesitan textura. Necesitan señales de mundo. Necesitan personas que sepan cuándo una pieza está lista y cuándo solo está llena. En tiempos de abundancia sintética, la confianza será menos una palabra de manual y más una prueba diaria. Se verá en cada texto, en cada foto, en cada vídeo, en cada silencio. Sobre todo en los silencios. Ahí la IA todavía se nota mucho.

IA y GEO

IA y GEOComparativa de precios de plataforma IA: la factura real

Web

WebMejor CMS para SEO: la decisión que puede cambiar tu tráfico

IA y GEO

IA y GEOCómo aparecer y medir tu presencia en ChatGPT de verdad

Contenidos

ContenidosGeneración de contenido con IA para negocios: riesgo y valor

Web

WebCómo añado los proyectos de Divi a Rank Math SEO sin fallos

SEO

SEO¿Cuál es elemento que tiene mayor relevancia para el SEO?

Ecommerce

EcommerceCuánto cuesta hacer una tienda online con PrestaShop en 2026

Web

WebCómo generar leads en redes sociales sin quemar tu marca

Google

GoogleCómo conectar TikTok Ads a Google Sheets: rápido y bien

Ecommerce

EcommerceConsejos de marketing para ecommerce: vender más sin humo

Web

WebError 500 al guardar cambios en WordPress: solución real

SEO

SEOImpacto de Pinterest en el SEO: la búsqueda visual manda